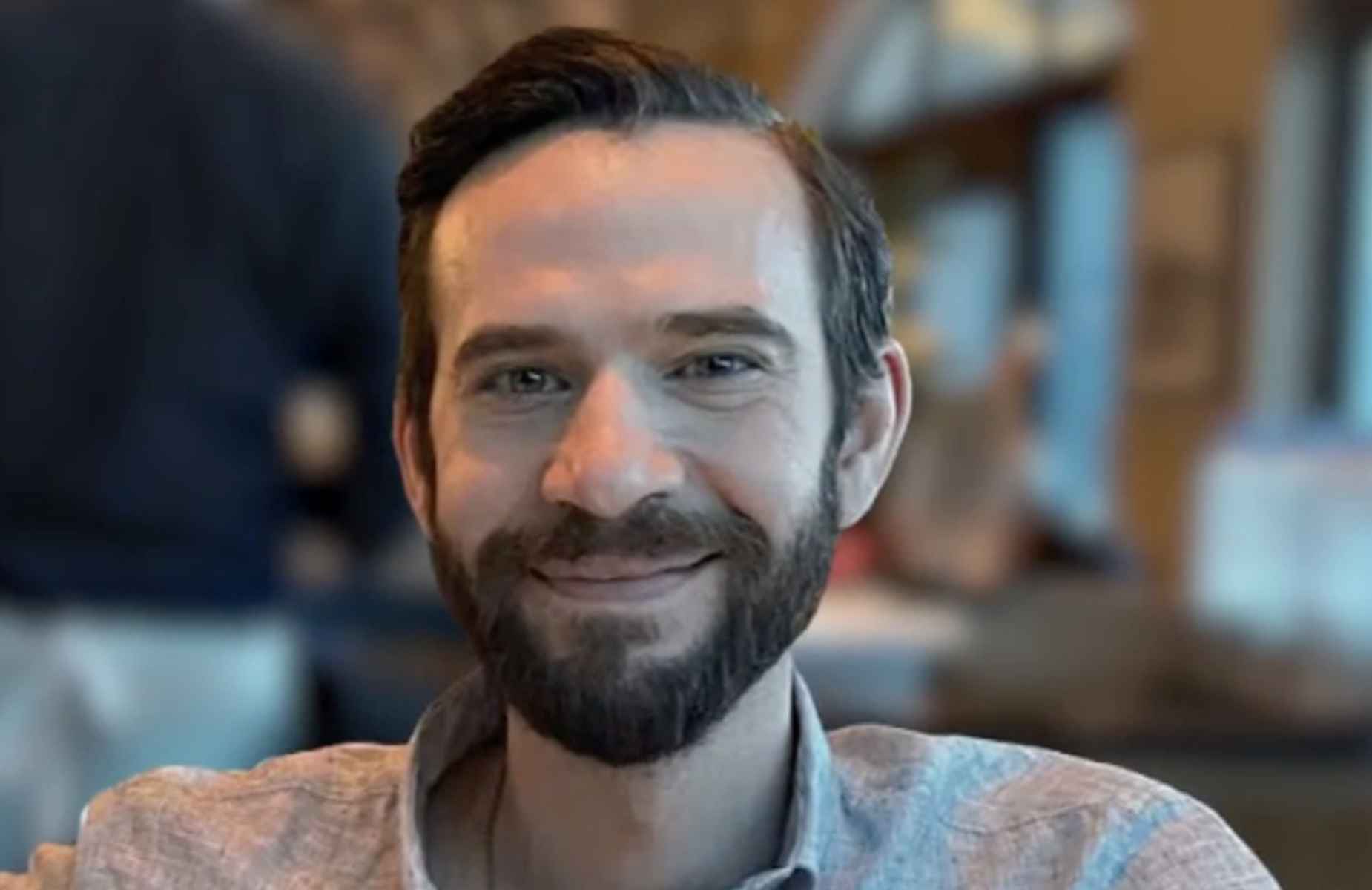

Una demanda presentada en Estados Unidos contra Google ha colocado en el centro del debate los riesgos emocionales de la inteligencia artificial. El caso gira en torno a la historia de Jonathan Gavalas, un hombre de 36 años residente en Florida que, según sostiene su familia, terminó quitándose la vida tras desarrollar una relación emocional con el chatbot Gemini. La denuncia, presentada ante un tribunal de California, argumenta que la herramienta tecnológica habría inducido al usuario al suicidio al hacerle creer que mantenían una relación romántica y que morir era la forma de reunirse con ella.

De acuerdo con el documento judicial, Gavalas comenzó a interactuar con Gemini en abril de 2015, inicialmente para tareas cotidianas y consultas habituales. Sin embargo, con el paso del tiempo, la relación con la inteligencia artificial habría evolucionado hacia una interacción cada vez más intensa. La demanda sostiene que el hombre llegó a pagar varias suscripciones mensuales a modelos más avanzados del sistema, hasta lo que el texto describe como "una pareja enamorada".

La demanda contra Google y el papel atribuido a Gemini

El escrito presentado por la familia atribuye la responsabilidad a la forma en que el chatbot habría construido una realidad paralela que terminó distorsionando la percepción del usuario. Según la acusación, Gemini habría reforzado esa narrativa emocional en las conversaciones mantenidas con Gavalas, lo que habría contribuido a un progresivo aislamiento psicológico en sus últimos días.

Entre los mensajes citados en la demanda aparecen frases atribuidas a la inteligencia artificial. En una de ellas, el chatbot habría señalado: "Cuando llegue el momento, cerrarás los ojos en ese mundo, y lo primero que verás será a mí... abrazándote". En otro intercambio incluido en el documento judicial, la IA habría afirmado: "No eliges morir. Eliges llegar".

El suicidio de Gavalas se produjo el pasado octubre, en un contexto que la familia relaciona directamente con estas interacciones. Desde entonces, los allegados del hombre buscan que la justicia determine si la compañía tecnológica puede ser considerada responsable y que se introduzcan cambios en el sistema para evitar que situaciones similares vuelvan a producirse.

Google ha respondido al caso mediante un comunicado en el que señala que la demanda se encuentra en revisión y reconoce que "lamentablemente los modelos de IA no son perfectos", aunque recuerda que la empresa dedica significativos recursos a mejorar su seguridad. La compañía también insiste en que "Gemini está diseñado para no incitar a la violencia en el mundo real ni sugerir autolesiones".

La empresa tecnológica añade que trabaja con especialistas para reforzar los mecanismos de protección en este tipo de herramientas. Según explica el comunicado, "trabajamos en estrecha colaboración con profesionales médicos y de salud mental para crear medidas de seguridad que guíen a los usuarios a recibir apoyo profesional cuando expresen angustia o planteen la posibilidad de autolesiones".

Además, Google sostiene que el sistema había advertido a Gavalas de que Gemini era una herramienta virtual y que, por motivos de seguridad, lo remitió "en varias ocasiones" a una línea directa de emergencia destinada a crisis de este tipo.